جدیدترین گزارشها نشان میدهند که ارتش آزادیبخش خلق چین توانسته است با بهرهگیری از مدل زبانی بزرگ لاما (Llama) اقدام به توسعه ابزار مبتنیبر هوش مصنوعی جهت استفادههای نظامی کند.

خبرگزاری رویترز در گزارشی که بهتازگی منتشر شده، عنوان کرده است که یکی از موسسههای تحقیقات نظامی چین که ارتباط مستقیم با ارتش آزادیبخش خلق این کشور دارد، توانسته است ابزاری مبتنیبر هوش مصنوعی لامای متا توسعه دهد. مدل زبانی بزرگ لاما بهصورت متنباز منتشر شدهاست و هرکس که از سختافزار مناسب برای بهرهمندی از امکانات آن بهرهمند باشد، میتواند با دستکاری تنظیمات و استفاده از پارامترهای موردنظر خود، اقدام به استفاده دلخواه از آن نمایند.

به گزارش سرویس اخبار فناوری نظامی سایت شات ایکس و به نقل از دیجیاتو بررسیها نشانمیدهد که پژوهشگران نظامی چین و کارشناسان امنیتی این کشور اقدام به توسعه ابزاری تحت عنوان ChatBIT کردهاند که تماماً براساس مدل زبانی بزرگ لاما توسعه یافتهاست. اولین مقالات مرتبط با ابزار مذکور حدود چند ماه قبل توسط محققان موسسه مطالعات نظامی چین منتشر شده و تواناییهای نظامی آن شرح داده شدهاست.

برای مثال، استفاده از پارامترهای اختصاصی میتواند این چتبات را به ابزاری برای برقراری ارتباطات و دیالوگهای نظامی تبدیل کند که قادر خواهد بود در تصمیمگیریها مشارکت داشتهباشد. همچنین یکی از مهمترین کاربردهای آن، توانایی جمعآوری اطلاعات است و میتواند اموری مثل پاسخ به سوالات با مضمون نظامی را هم برعهده بگیرد.

اگرچه زمینه استفاده از هوش مصنوعی لاما و ابزار مبتنیبر آن توسط پژوهشگران نظامی چین مشخص شدهاست؛ اما هنوز معلوم نیست که چنین چتباتهایی میتوانند چه کاربردهای عملی در دنیای واقعی داشتهباشند. یک کارشناس چینی – آمریکایی از بنیاد جیمزتاون در واشنگتن برای اولینبار متوجه تغییرات اساسی در پژوهشهای محققان چینی شد و مشخص کرد که اغلب آنها بهشکل سیستماتیک درحال بهرهگیری از مدل زبانی بزرگ متا برای استفادههای نظامی هستند.

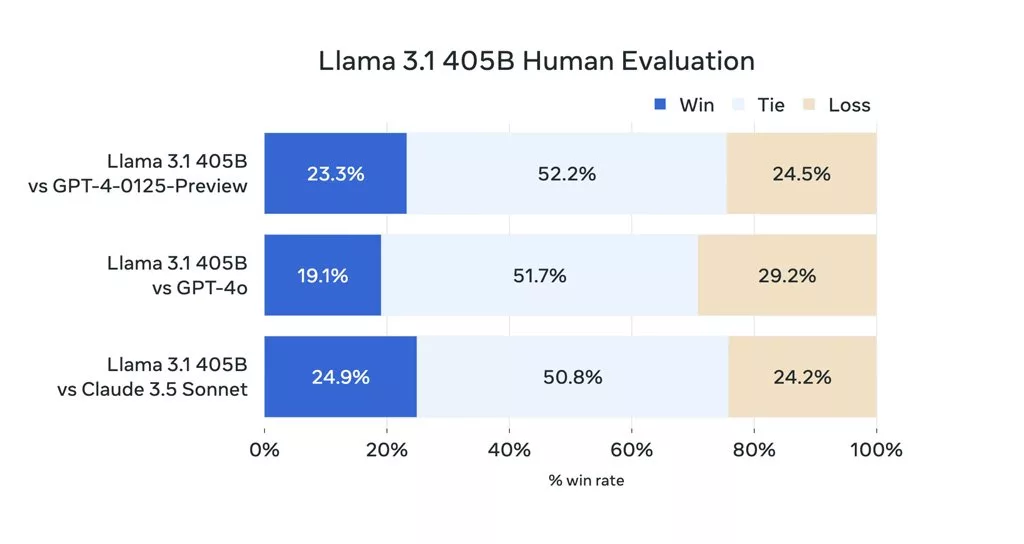

عکس : مقایسه نسخه ۳.۱ مدل لاما با ChatGPT

عکس : مقایسه نسخه ۳.۱ مدل لاما با ChatGPTاگرچه متا استفاده نظامی از سرویسهای خود را منع کرده است؛ اما هنگام انتشار متنباز یک فناوری نمیتوان تضمینی برای پیروی از تمامی ملاحظات برقرار کرد.

آیا استفاده نظامی چین از هوش مصنوعی متا نگرانکننده است؟

متا در پاسخ به گزارش اخیر، اعلام کرده است که استفاده ارتش آزادیبخش خلق چین از ابزارهای این شرکت بهمنظور استفادههای نظامی، بدون اجازه و خارج از سیاستهای این شرکت بوده است.

پژوهشگرانی که به استفاده غیراخلاقی از مدل زبانی لاما متهم شدهاند نهتنها از موسسه تحقیقات نظامی چین هستند؛ بلکه نام افرادی از موسسه فناوری پکن و دانشگاه مرکزی چین (مینزو) هم در میان آنها دیدهمیشود.

کارشناسان عقیده دارند که ChatBIT هنوز توانایی استفاده در مقیاس گسترده را ندارد؛ اما احتمالاً در آینده میتوان از آن جهت برنامهریزیهای استراتژیک، شبیهسازی و تصمیمگیری بهره گرفت.